ai - 自行搭建huggingface deepseek r1 ollama openwebui chatbox siliconflow.cn 硅基流动

访问量: 39

refer to:

https://www.bilibili.com/video/BV1ux4y1Q7zN/?spm_id_from=333.337.search-card.all.click

https://www.bilibili.com/video/BV1ux4y1Q7zN/ 轻松搭建本地大模型 ollama + openwebui

前提:你的机器需要有一个gpu, 否则会有问题,最好是n卡 . 起步是 2060, 也可以用 p40这样的计算卡。

ollama : 用来运行大模型的,跟docker比较像. https://github.com/ollama/ollama

openwebui: 用来运行大预言模型的交互端。 一个web应用。https://github.com/open-webui/open-webui

deepseek: 国产的大模型,特别牛逼。 r1 是最新版本。https://www.deepseek.com/

不同的参数: 越大越厉害。 不过需要消耗的资源也越多. , 17b, 7b, 80b

本地化部署:可以问平时不方便问的问题,例如黄堵独。

蒸馏,nsfw: not safe for work. 对于工作不安全,意思是啥都可以问,不限制

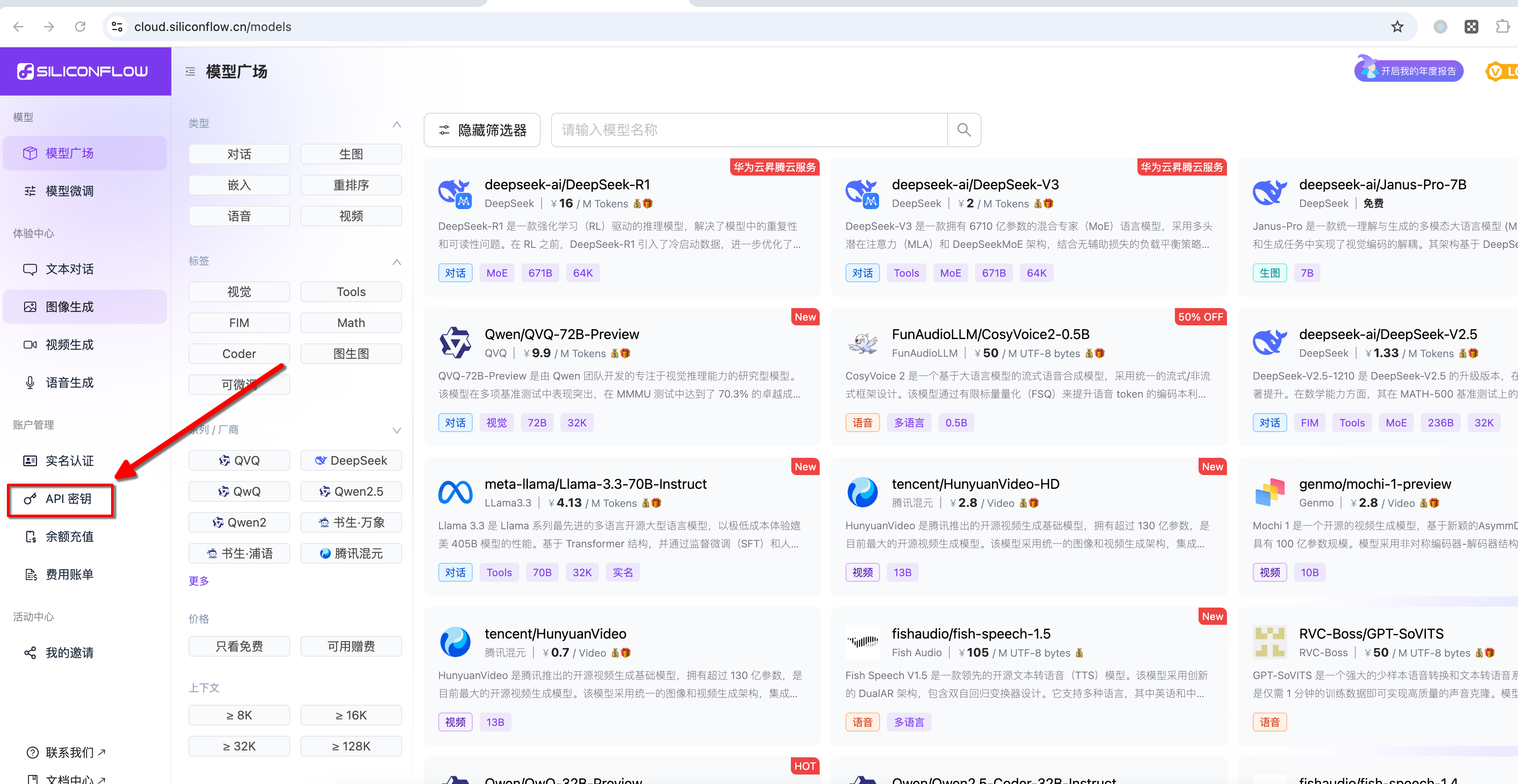

线上服务: 硅基流动 , 注册后申请个api,使用chatbox 即可使用。

硅基流动:siliconflow: https://cloud.siliconflow.cn/models

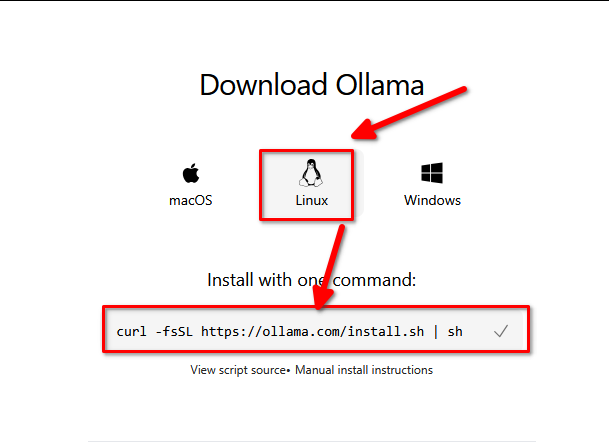

https://ollama.com/download/linux

对于Linux,貌似安装起来麻烦。

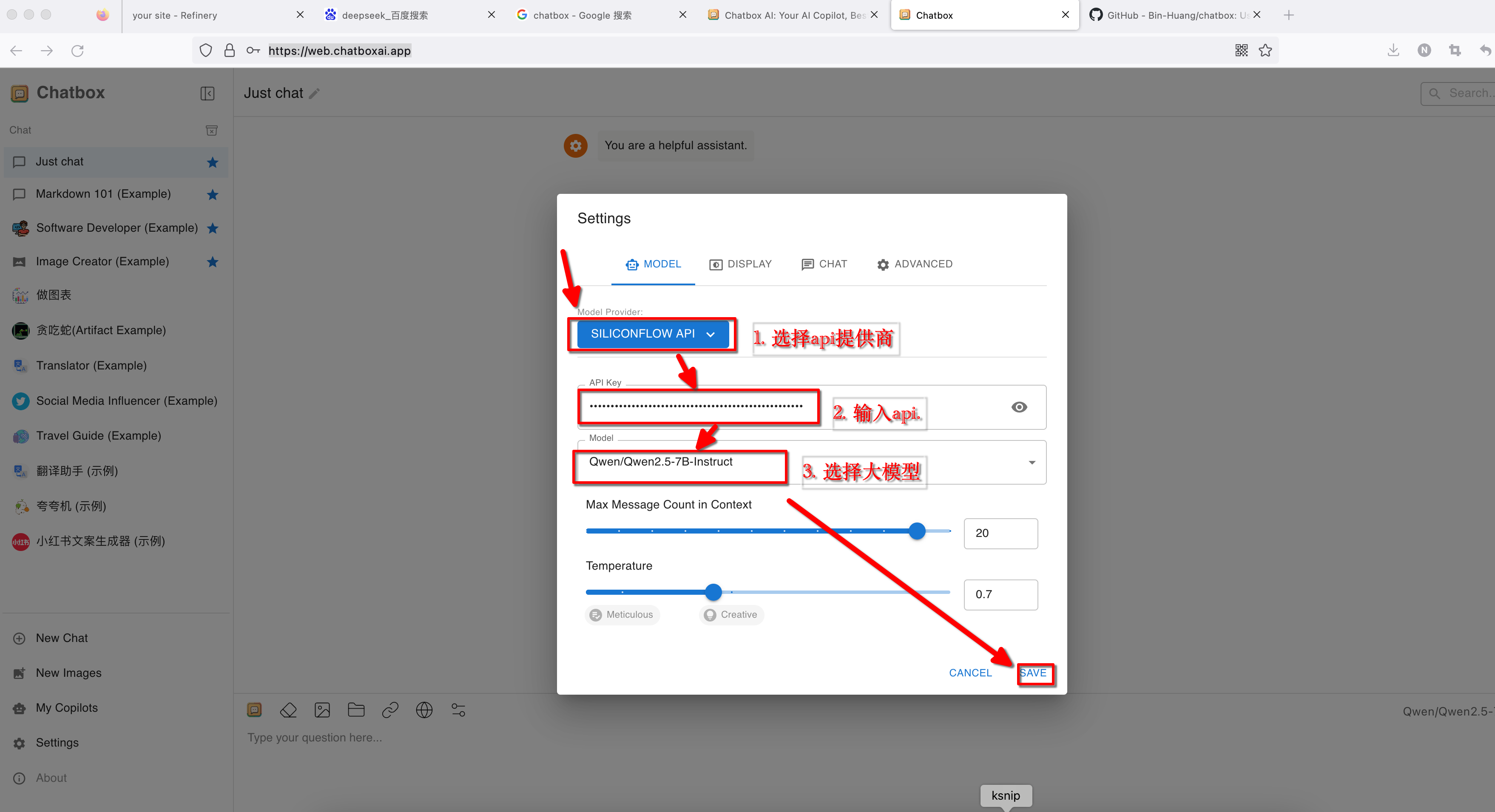

1. 使用 api + web ui 的形式(最简单,不需要任何硬件)

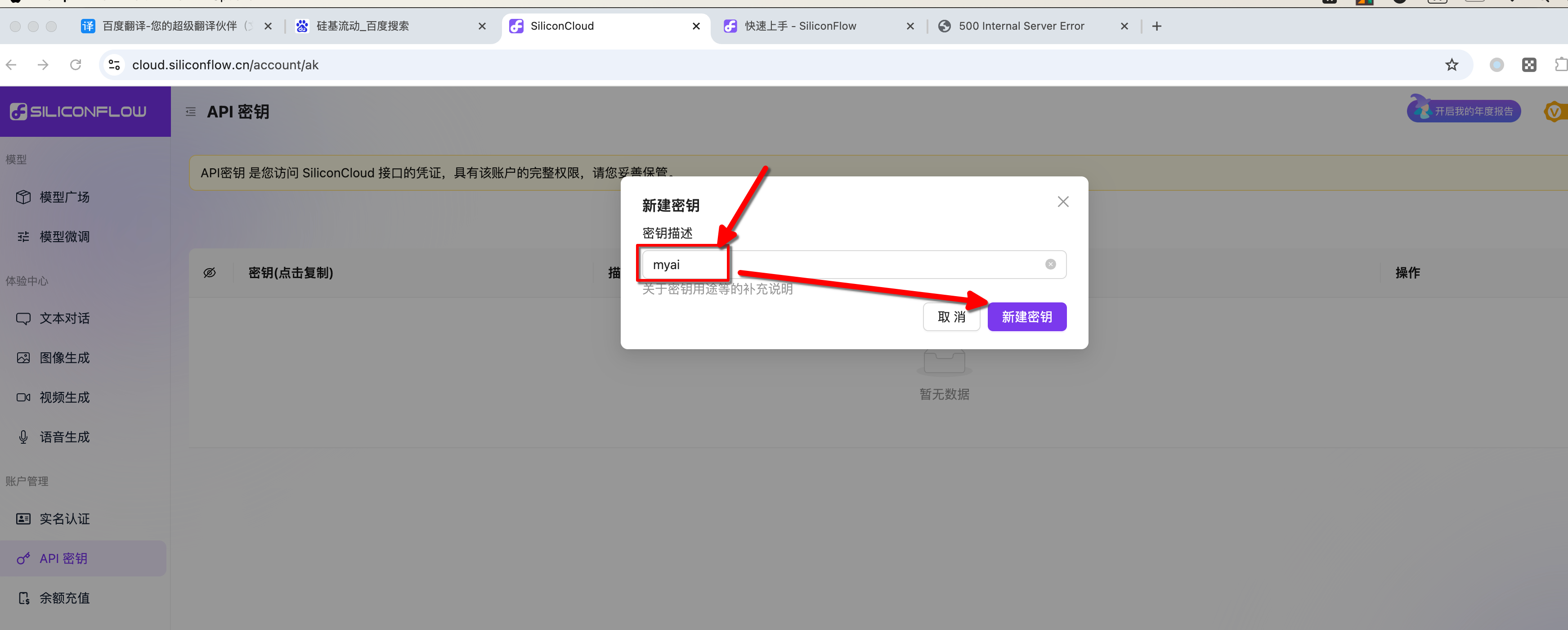

1.1 注册硅基流动:

1.2 获得api

1.3 打开 chatbox的web端版本

1.4 设置相关的api, 供应商,大模型等。 人家都帮我们调整好了。

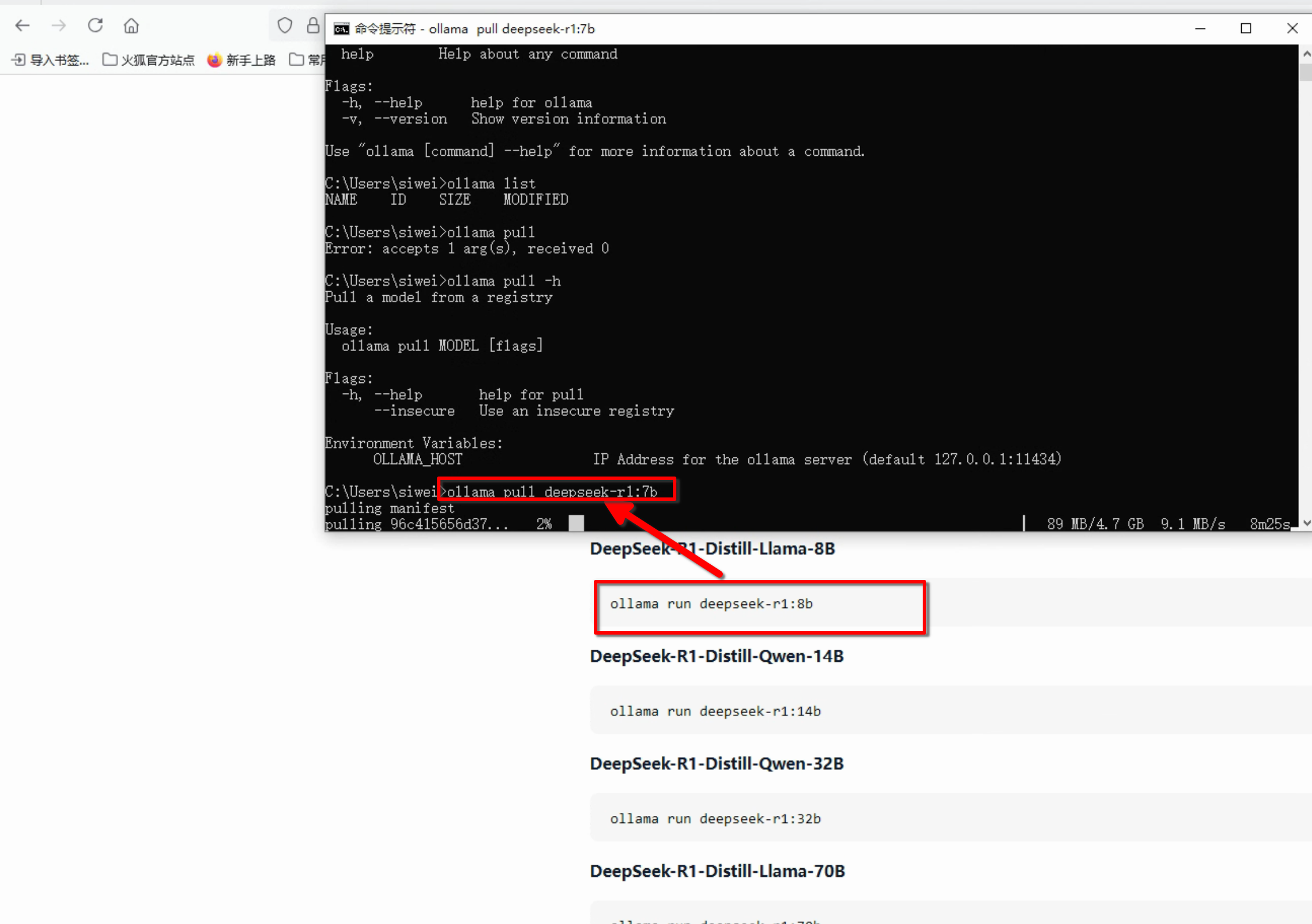

2. 在本地运行大模型(我使用了windows ) OLLAMA

https://ollama.com/download/linux

2.1 下载 ollama 的windows版本

2.2.a 安装之。(简单的点一下install就好了)

2.2.b linux下面也是一样。

2.3 这个东西安装好之后,就是个命令行,用起来跟docker是一样的。

>>> Installing ollama to /usr/local >>> Downloading Linux amd64 bundle ######################################################################## 100.0% >>> Creating ollama user... >>> Adding ollama user to render group... >>> Adding ollama user to video group... >>> Adding current user to ollama group... >>> Creating ollama systemd service... >>> Enabling and starting ollama service... Created symlink /etc/systemd/system/default.target.wants/ollama.service → /etc/systemd/system/ollama.service. >>> The Ollama API is now available at 127.0.0.1:11434. >>> Install complete. Run "ollama" from the command line. WARNING: No NVIDIA/AMD GPU detected. Ollama will run in CPU-only mode.

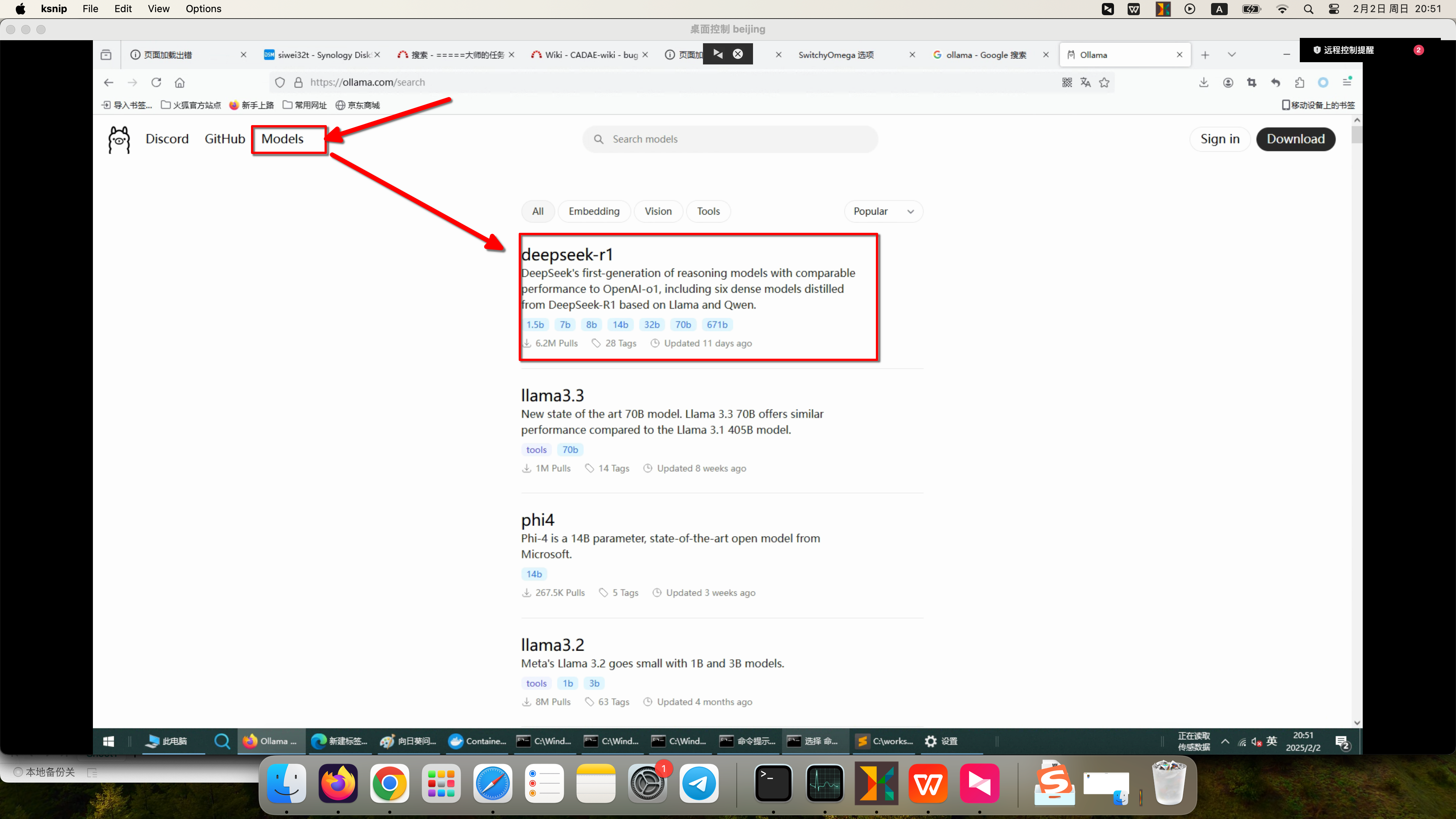

2.4 ollama上找到你想要的模型,例如 https://ollama.com/library/qwq qwq 推理模型

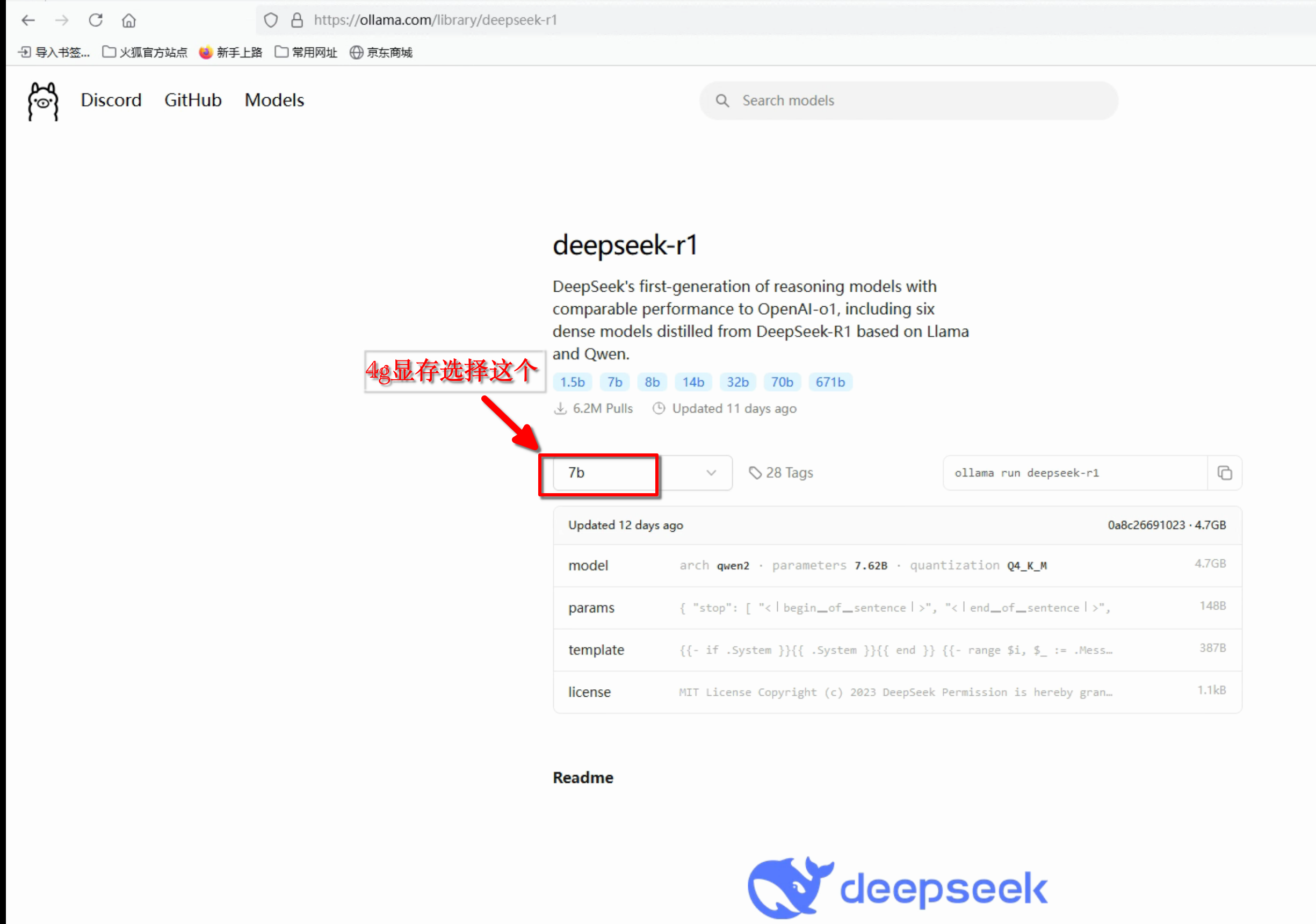

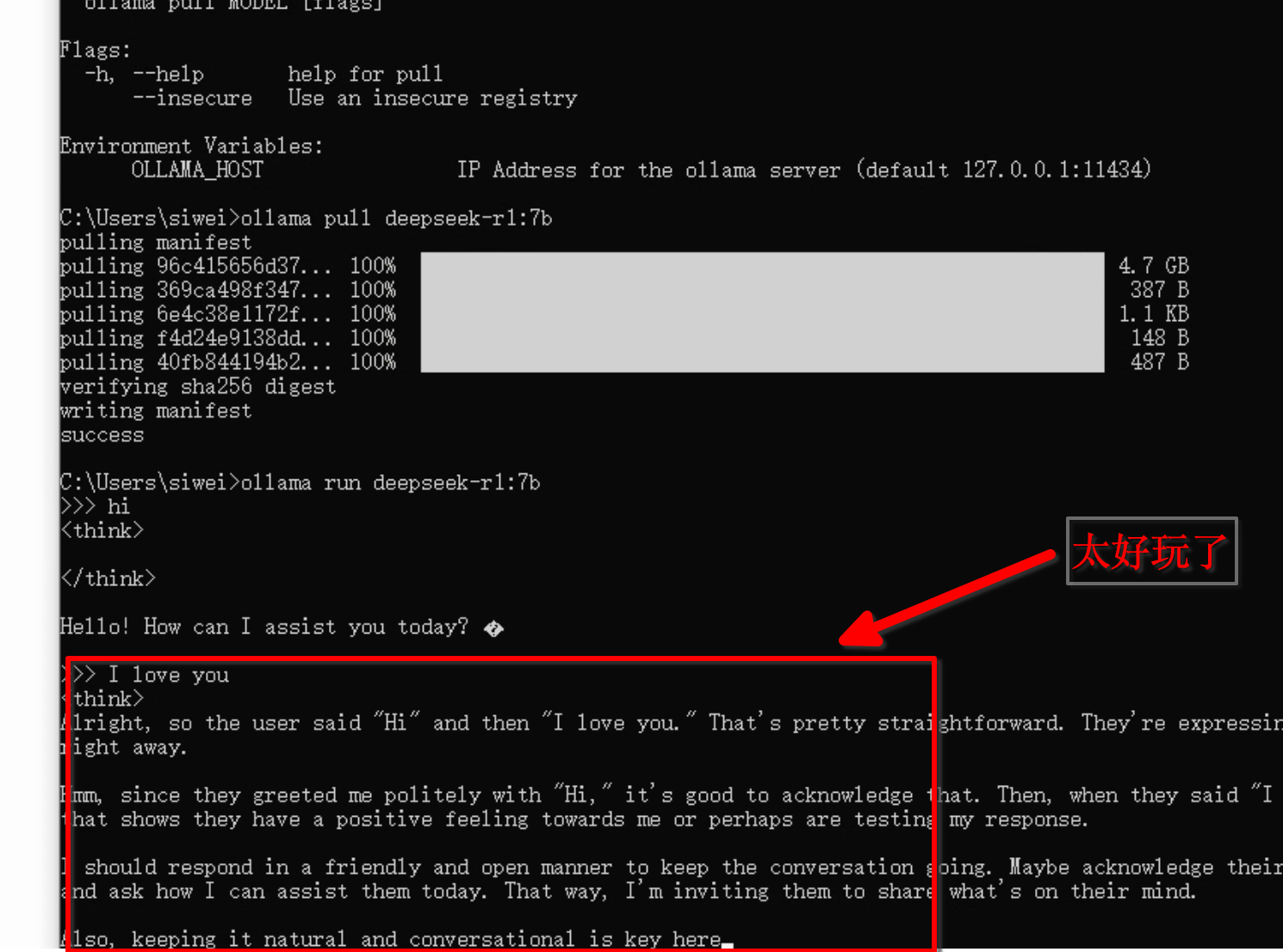

选择这个deep-seek 7b的

因为我只有4G显存

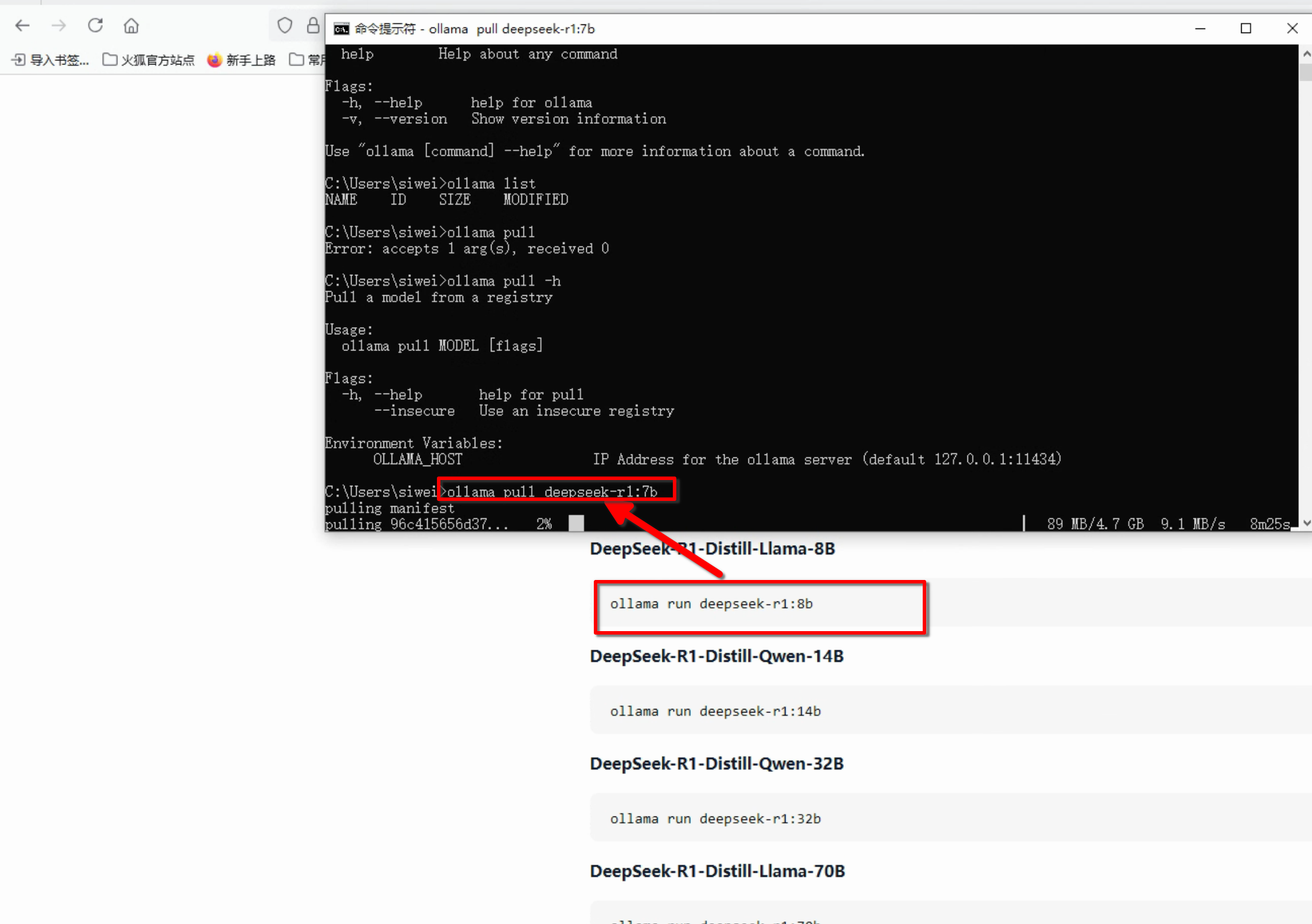

2.5 运行ollama

ollama run deepseek-r1:7b

我这里下载速度很快(11MB以上)

2.6 可以在命令行中使用了:

2.7 使用 openwebui 来作为web客户端:

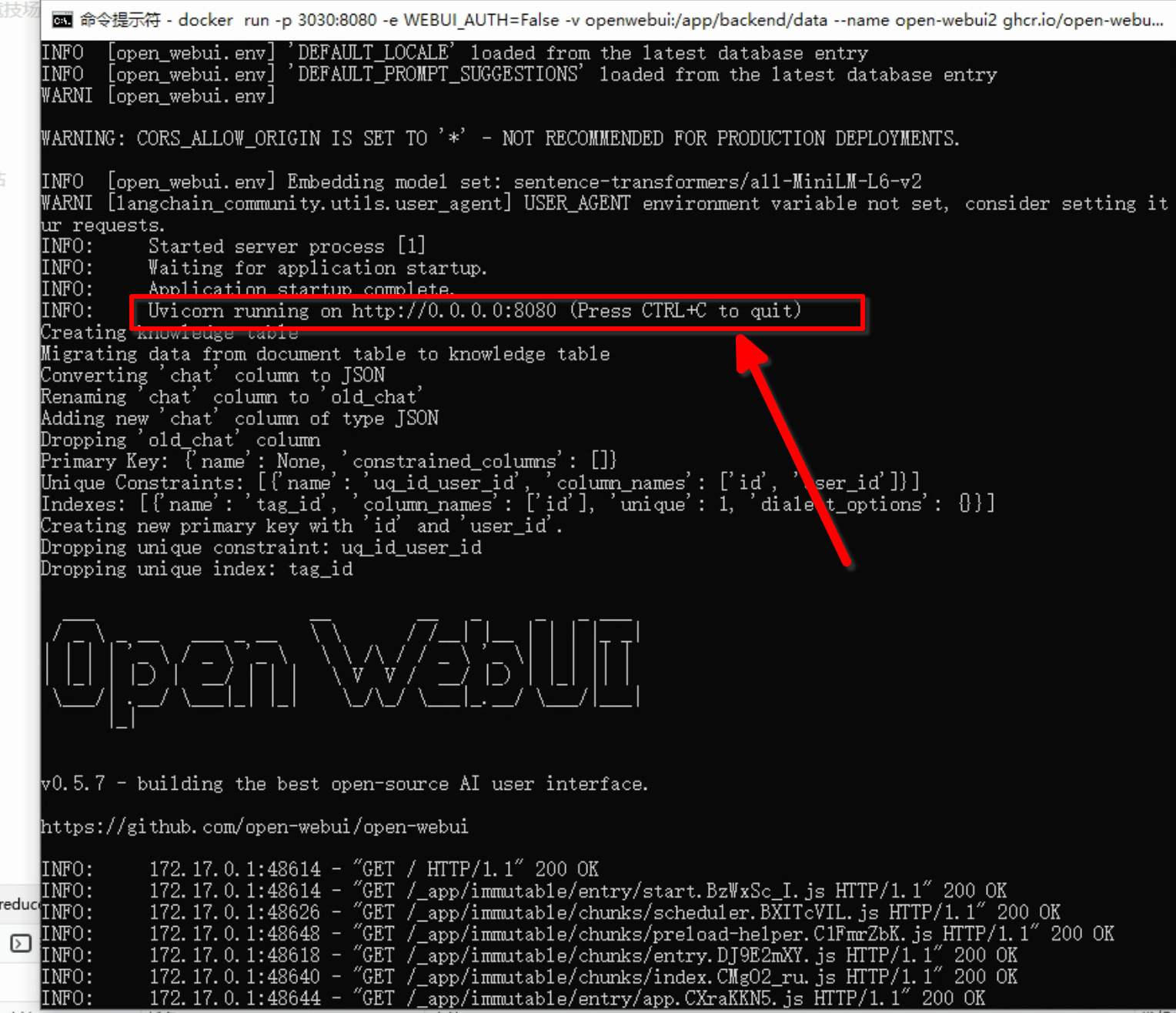

我的windows下的docker, 只能运行这个命令:

docker run -p 3030:8080 -e WEBUI_AUTH=False -v /c/workspace/docker_folder/openwebui:/app/backend/data --name open-webui4 ghcr.io/open-webui/open-webui:main

如果加上了 --gpus all ,就会报错。

C:\Users\siwei>docker run -p 3030:8080 --gpus all -e WEBUI_AUTH=False -v /c/workspace/docker_folder/openwebui:/app/backend/data --name open-webui4 ghcr.io/open-webui/open-webui:main

docker: Error response from daemon: failed to create task for container: failed to create shim task: OCI runtime create failed: runc create failed: unable to start container process: error during container init: error running hook #0: error running hook: exit status 1, stdout: , stderr: Auto-detected mode as 'legacy'

nvidia-container-cli: initialization error: WSL environment detected but no adapters were found: unknown.

所以我就索性不加了,一样可以运行 openwebui

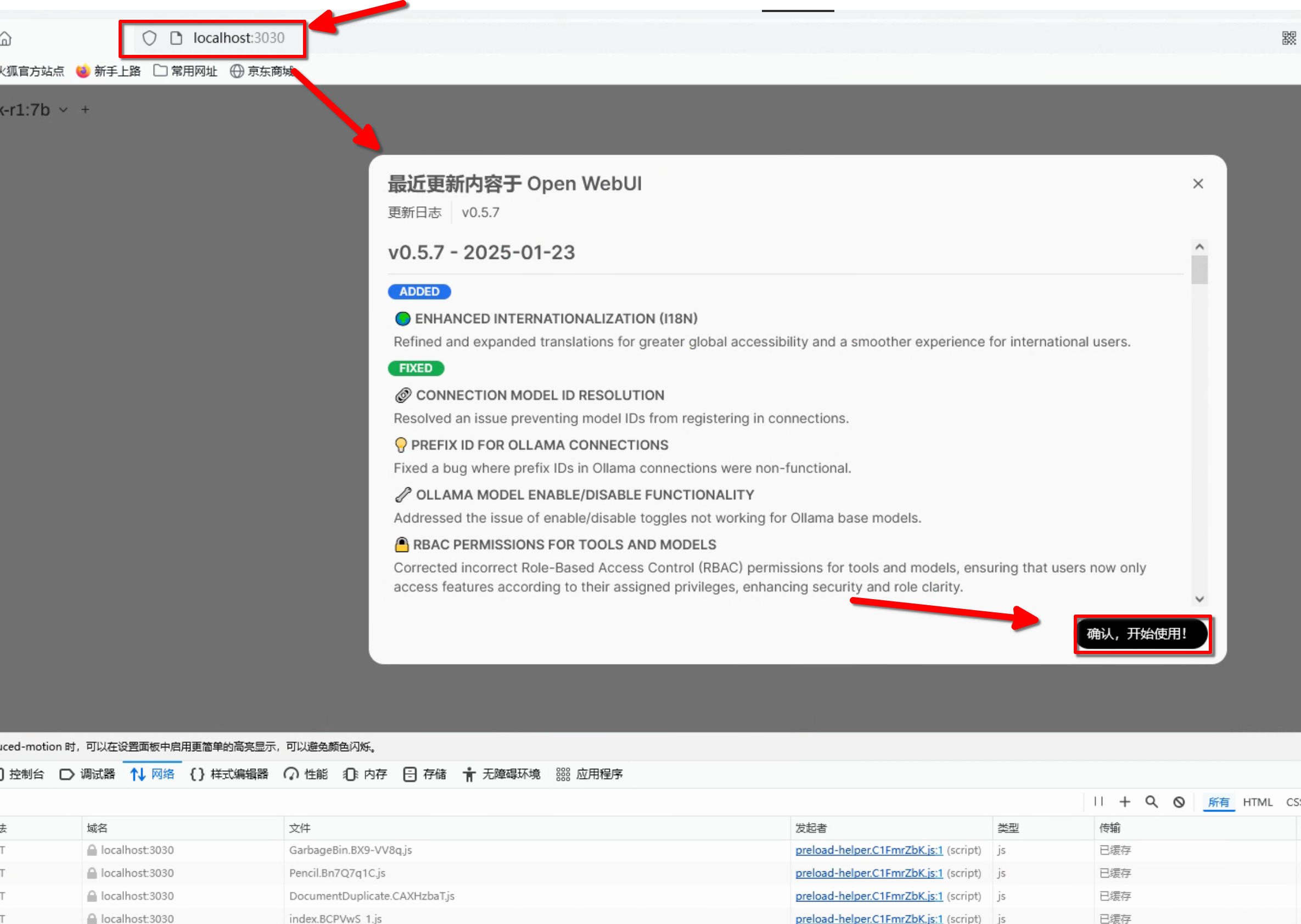

2.8 就可以使用了:

docker 命令行中,看到这一句,就表示可以使用了:

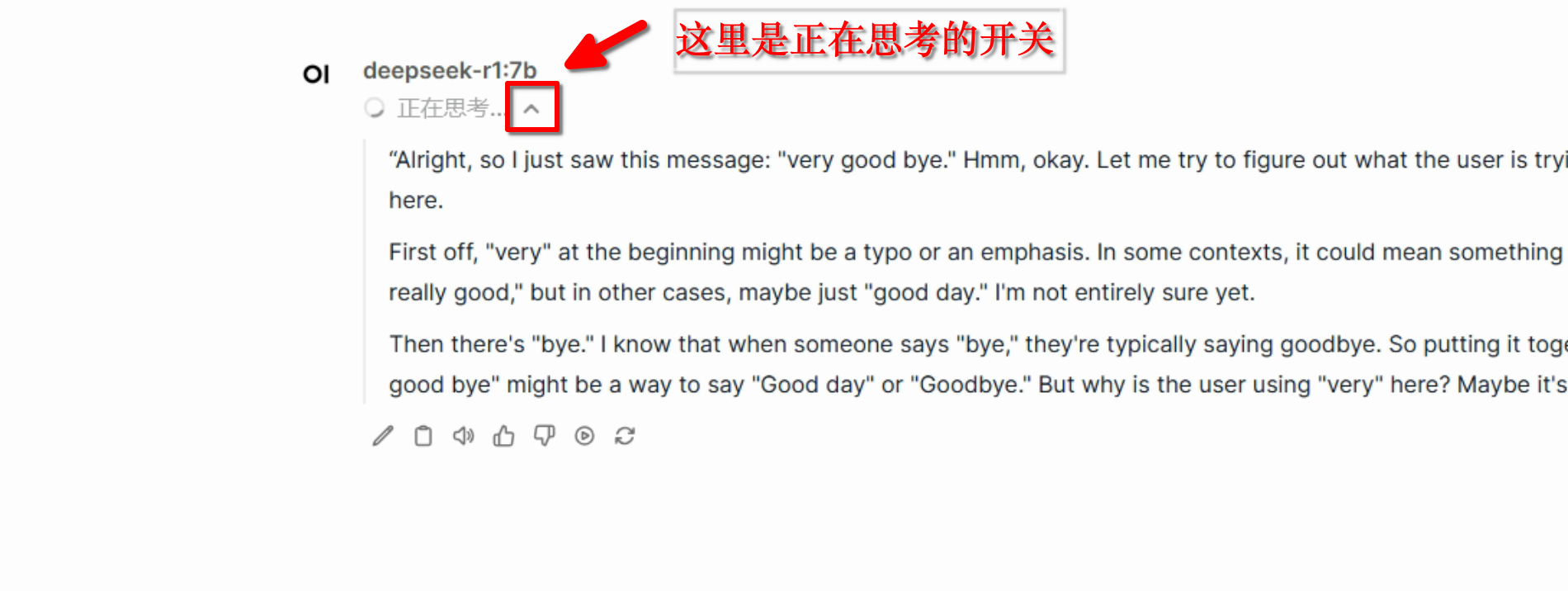

这个是打开深度思考的开关: